Häromdagen, den 13e mars, hade jag förmånen att i regi av Sveriges Lärare föreläsa om AI och bedömning. Inspelningen finns nu tillgänglig för alla.

Du hittar inspelningen här. Själva föreläsningen börjar ca 20 minuter in i klippet.

Häromdagen, den 13e mars, hade jag förmånen att i regi av Sveriges Lärare föreläsa om AI och bedömning. Inspelningen finns nu tillgänglig för alla.

Du hittar inspelningen här. Själva föreläsningen börjar ca 20 minuter in i klippet.

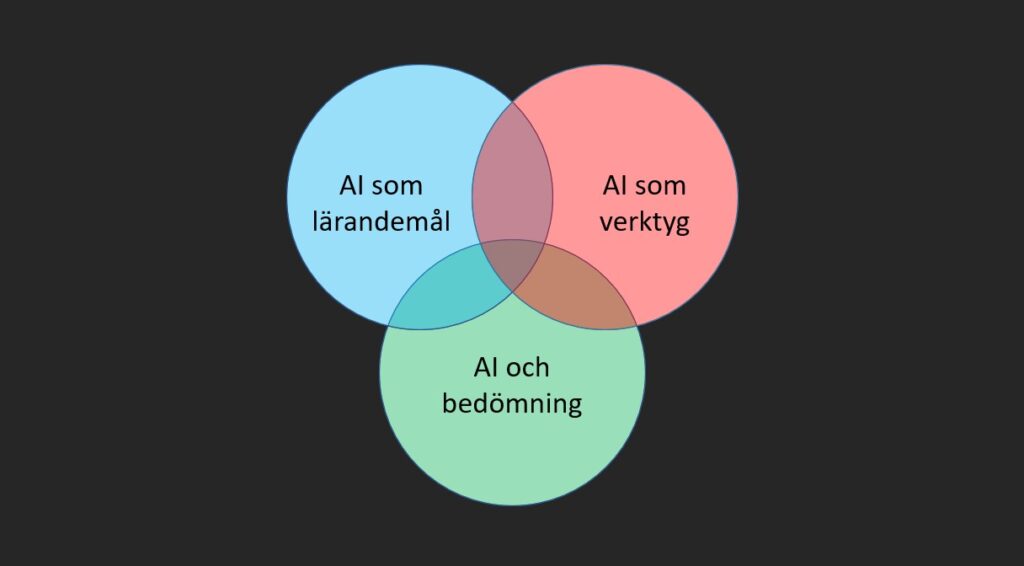

Efter över ett år med erfarenhet av AI och skolan har jag landat i att tänka kring området utifrån tre aspekter: AI som lärandemål, AI som verktyg och AI och bedömning. Tre olika aspekter som särskiljer sig men som också överlappar.

AI som lärandemål handlar dels om AI-litteracitet, dvs. allmän AI-kunskap, något som numer behöver ingå som en röd tråd i alla ämnen precis som exempelvis hållbar utveckling. Men dels handlar det om hur det centrala innehållet i olika ämnen och kurser färgas av generativ AI. I skolans läroplaner nämns inte AI explicit men i exempelvis syftesskrivingen för ämnet samhällskunskap för gymnasiet finner vi skrivningar såsom:

”Ett komplext samhälle med stort informationsflöde och snabb förändringstakt kräver ett kritiskt förhållningssätt och eleverna ska därför ges möjlighet att utveckla ett sådant. Det omfattar förmåga att söka, strukturera och värdera information från olika källor och medier samt förmåga att dra slutsatser utifrån informationen.”

I skrivningarna för teknikämnet står det bland annat:

”Undervisningen ska ge eleverna möjligheter att reflektera över teknikens historiska utveckling. Därmed får de bättre förutsättningar att förstå samtidens tekniska företeelser, hur tekniken och samhällsutvecklingen påverkar varandra samt hur teknik kan användas på ett ansvarsfullt sätt.”

Och för svenskämnet står det:

”Undervisningen ska även syfta till att eleverna utvecklar förmågan att skapa och bearbeta texter, enskilt och tillsammans med andra. Eleverna ska ges möjlighet att kommunicera i digitala miljöer med interaktiva och föränderliga texter.”

Ovan exempel är tre bland många där AI inte nämns explicit men som till följd av den senaste tidens utveckling är svåra att möta utan att adressera AI i undervinsingen.

AI som verktyg är i grunden ett socioteknologisk område som berör människans samverkan med teknologi och hur denna interaktion i detta sammanhang kan förstås i lärandeprocesser. Det är exempelvis frestande att se AI som ett enkelt sätt att uppnå mål, likt hur nya verktyg kan erbjuda genvägar i olika sammanhang. Men detta perspektiv missar en avgörande poäng när det gäller utbildning och lärande. Den verkliga frågan blir om användandet av generativ AI, i sammanhanget av lärande och utbildning, kan jämföras med användandet av nya verktyg som på ytan förenklar uppgifter men också kan undandra den djupare lärprocessen. Nyligen genomförda undersökningar visar att en betydande del av unga använder generativ AI i sitt skolarbete, där en del medger att syftet varit att underlätta eller kringgå traditionella lärandeprocesser. Detta väcker frågor om vad som egentligen utgör fusk och vad som är en legitim användning av teknologi i lärande. Teknikentusiaster argumenterar ofta för att användningen av teknik i utbildningssyfte bör ses som en utveckling snarare än fusk, där det viktiga är förmågan att använda ny teknologi effektivt. Men det är just sådana argument som kan föra oss fel.

Problemet menar jag uppstår när vi felaktigt börjar se måluppnåelse som det sanna måttet på lärande. Lärande, i dess mest grundläggande form, handlar inte bara om att nå ett slutresultat, utan om resan dit. Den processen inbegriper inte bara att absorbera kunskap, utan också att utveckla kritiskt tänkande, problemlösningsförmåga och förmågan att reflektera över den information och de verktyg vi använder.

I ljuset av den senaste tidens framsteg inom kognition och lärande blir det allt viktigare att förstå teknologi inte bara som ett verktyg för att effektivisera lärande, utan som en faktor som djupt påverkar hur vi lär oss, vad vi lär oss och på vilket sätt vi interagerar med kunskap. Användningen av AI i utbildning ställer krav på en nyanserad förståelse som tar hänsyn till dessa faktorer, där vi behöver fundera kring hur vi balanserar mellan teknologins möjligheter och riskerna med att förlita oss för mycket på den.

AI och bedömning – Bedömning är en oundviklig del av utbildningen eftersom den ger oss insikter om elevernas utveckling och kunskapsnivå. Här uppstår frågor om hur AI påverkar vår syn på lärande och kunskap. Vi behöver fundera över vad lärande egentligen är och hur teknologin relaterar till detta begrepp. Diskussionen är omfattande och fascinerande och utgör hjärtat i mitt intresse för AI i skolan.

Alla tre av dessa aspekter är komplexa och sammanflätade, och mina reflektioner är fortfarande i utveckling. Jag skulle gärna vilja höra vad andra tänker om dessa frågor. Finns det några dimensioner jag har missat? Finns det något som bör tilläggas eller förtydligas? Jag välkomnar alla insikter och åsikter.

Igår släpptes en 21-minuters video som demonstrerade den kommande kanalen Channel 1, en helt AI-genererad nyhetsstation. Troligtvis kommer vi att se otaliga liknande initiativ framgent. Utvecklingen väcker många frågor som rör upphovsrätt, bias, journalistik och källkritik etc. Bara timmar efter att videon släpptes har röster höjts som diskuterar detta (se t.ex. Daily Mail eller Hollywood Reporter).

Men en aspekt som inte adresserats lika tydligt är de konsekvenser för en uppmärksamhetsekonomi (attention economy) som generativ AI kan komma att få. Exemplet med Channel 1 handlar om nyheter, men det handlar också om att fånga tittarnas intresse genom ett skräddarsytt innehåll.

Att fånga användaren genom att anpassa innehållet är en central del av flera sociala medier. TikTok är närmast ökänt för sina effektiva algoritmer som genom ett mycket kort användande anpassar flödet av media efter användandet. Men det handlar fortfarande om dels en anpassning baserat på den tid som läggs på exempelvis olika filmer, dels om förmedlandet av användargenererat material. Är det filmer på söta hundar som fångar din uppmärksamhet kommer du att förses med fler filmer på söta hundar som andra användare lagt upp.

Den förändring som vi antagligen ser framför oss är dels att teknologin inte bara registrerar den tid som ägnas åt exempelvis videoklipp, utan också samlar in biometriska data såsom ögonrörelser och pupillreaktioner och använder denna som data; dels att innehållet också helt genereras optimerat för den enskilde användaren.

Om det var svårt att lägga ifrån sig skärmen förut, kommer det att bli i princip omöjligt framgent.

Det är med oro jag tänker på en sådan framtid. För att inte hamna där tror jag vi behöver reglera de ekonomiska incitamenten för företag som TikTok och kommersiellt styrda mediebolag. Jag minns ett möte jag hade för många år sedan med ett av Sveriges reklamfinansierade TV-kanaler där en av kanalens chefer inledde mötet med att påpeka att de fört och främst var ”en marknadsföringsmuskel, inget annat”. Ett sådant krasst perspektiv kommer att bli mycket problematiskt framgent.

Frågan är hur vi kan hantera dessa utmaningar utan att göra det hela till en infekterad höger- och vänsterfråga.

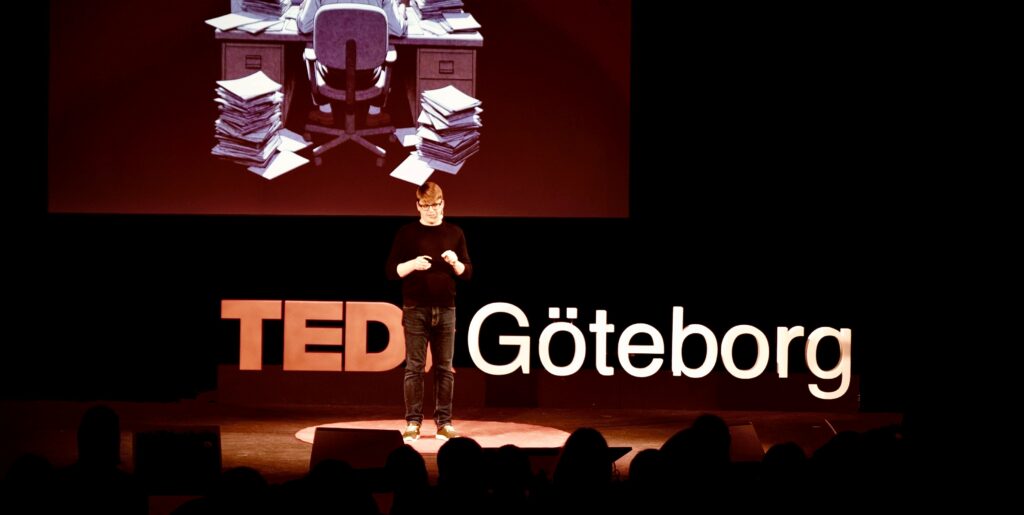

Igår publicerades mitt TEDx-talk. Talet höll jag under ett TEDx-event på Chalmers i oktober och efter några veckor med fix och trix är det nu godkänt och tillgängligt för allmänheten. Att titta och lyssna på sig själv tror jag kanske aldrig att man vänjer sig vid, och i efterhand hade jag velat ändra på flera saker. Men nu ligger det där till allmän beskådan. Stort tack till alla på TEDx Göteborg såg till att det blev möjligt!

Nedan talet samt manuset jag utgick ifrån.

They say that the best way to start a speech is by saying ’once upon a time.’ To tell a story. And you begin by painting a picture of something that represents us – a small town. And then you should introduce something that comes and threatens that town. A problem; a dragon. Finally, you should also include a solution; a rescue, a knight.

But when it comes to AI, it’s not entirely clear what role this new technology is going to play.

Is AI the dragon, or is AI the knight?

I work as a teacher, and I’ve been in the education field for almost two decades. And in this story of us and AI, the matters concerning learning and education interest me the most.

Lately, I have been given a chance to pursue a PhD. My research focuses on how teachers like me are dealing with the impact of the latest developments in generative AI. In particular, I’m exploring how it’s changing the way we see and evaluate our students’ learning and knowledge.

The most common initial reaction from teachers, or anyone, is that students might use AI technology in order to cheat. However, when it comes to learning, knowledge and technology, it’s not entirely clear what constitutes cheating and what doesn’t.

To explain, let me give you one well-used analogy – pole vaulting.

This is Armand Duplantis. He holds the men’s world record with 6.23 meters.

Here is Charles Hoff, a Norwegian who held the world record a hundred years ago. In 1923 he cleared 4.21 meters.

Back then, I actually think Hoff was quite happy that he didn’t jump over six meters. Because in 1923, they landed in a thin layer of sand.

In a hundred years, the record has increased by over two meters, or in other words, by 48%.

That’s a lot.

When one, for example, compares with the corresponding development in the men’s 100 meters, the improvement is significantly smaller, just 8%.

So why has the record increase been so large in pole vaulting?

The most obvious explanation lies in the technological development of the pole.

When Charles Hoff set his record, he used a pole made of hardwood. And hardwood poles are not great at converting horizontal motion into vertical height (*use hand gestures here to symbolize movement). When flexible poles came along, it transformed the sport.

Here, it is also interesting to note that every time a new, improved pole has been introduced, those sticking to the old ones often point fingers at the newcomers and accuse them of cheating!

The question is whether generative AI, in relation to learning and education, is comparable to what new types of poles have been for pole vaulting. Is it cheating to use ChatGPT to write a text that you are going to submit as a school assignment?

Just a few weeks ago, the results of a major survey here in Sweden were released, where young people between 15 and 24 were asked if they had used generative AI in their school work. 36% said they had, and of them, 55% admitted that they had used AI in order to cheat.

An additional 12% said they were unsure whether it had been cheating or not when they used it.

Now, within education, tech enthusiasts often argue that using technology should be seen as cheating. The argument is that what’s important is learning how to use the new technology. What matters is the result, the height of that bar. If students can use AI as a “flexible pole” to get over even higher obstacles, then surely that’s a good thing?

But it is precisely such arguments that might lead us to mistake the dragon for the knight.

You see, the problem arises when we mistakenly view achieving a goal as the true measure of learning.

Because in the context of learning, it’s actually the journey towards that goal where the real learning takes place.

Let’s use another metaphor:

Imagine that your coach tells you to run to a particular spot. It’s probably because your coach wants you to build up your physical fitness by covering a specific distance. If you use something like a bicycle or take a shortcut to get there quicker, you might reach the spot, but you won’t get the physical training you were supposed to, even if you arrive at the destination.

Now let’s move from the physical world metaphor to a digital one.

Who here has played the first classic 8-bit Super Mario game?

Have you ever reflected that Super Mario is the same basic character on every level, and to progress in the game, it is you, the player, that has to get better? Compare that to most popular games today, where you can pick up enhancements along the way that enable you to advance through harder levels. Sometimes, you can even buy these enhancements; no skill development is needed! As you progress through the game, you might live in the delusion that you are getting better than what you actually are. In such cases, technological enhancements might cause an illusion of learning.

So, what’s the point I’m trying to make here? Am I saying we shouldn’t teach students how to use technology like AI in schools? No, that’s not my point. What I’m getting at is that it’s complicated. Cheating and learning aren’t always black and white. Let me give you another example.

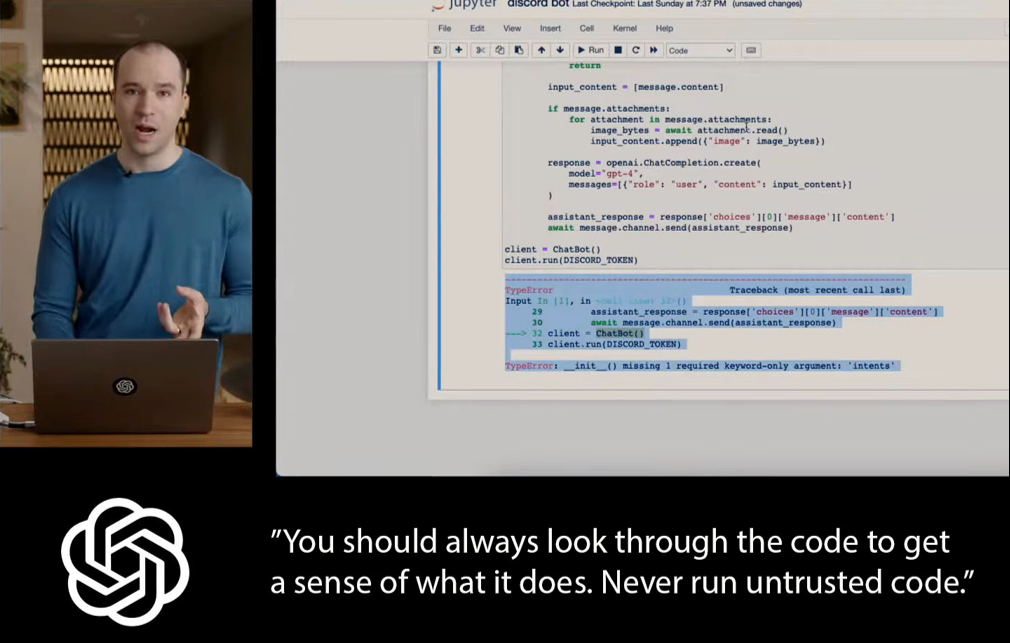

This is Greg Brockman, a key figure at OpenAI, the company behind ChatGPT. In March of this year, they unveiled their new AI model, GPT4, in a live YouTube demonstration. Brockman showcased its amazing capabilities.

For instance, he presented a rough sketch of a website and told GPT4 to generate the code for it. In less than a minute, he had usable code, and voilà, a working website was born. The audience was left in awe; it was truly impressive!

But there was something Brockman emphasized during this demonstration. In one instance, When the AI wrote the code, he said:

”You should always look through the code to understand what it does. Never run untrusted code.”

At that moment, it was clear that Greg Brockman could read code as easily as I read my mother tongue – Swedish. How did he become so skilled at this? Well, probably because he’s spent years writing a ton of code.

For someone with such expertise, having a system that automates this process is a huge time-saver and makes them more efficient. And that’s a good thing. But for those who aren’t as skilled, this kind of automation might mean missing out on a valuable learning opportunity.

Now, some might argue that in the future, we won’t need to know how to write and read code anymore. When machines can do something, why should humans bother doing it? And there are certainly cases where that’s true. If machines can handle tasks that are harmful or dangerous for humans, they arguably should.

But in many other cases, just because a machine can do something doesn’t automatically mean that it ought to. This becomes especially clear when we make the mistake of focusing too much on the goal. When we see the height of that bar as the only thing that matters.

It’s not only the most obvious learning that can get lost with automation. There are other learnings and valuable aspects in this process. And we risk losing them with automation.

Let me give you another example. This time, an example from education.

As mentioned earlier, teachers often worry that their students might try to cheat using AI. But let’s flip the script for a moment. Teachers themselves can be tempted to take shortcuts. If you’ve ever been a teacher, you probably know the feeling of sitting up late on a Sunday evening, facing a mountain of assignments to grade before Monday morning.

Now, imagine there’s a magic button on your computer that can instantly and accurately assess all those assignments. The temptation to push that button would be strong. I’ll admit, I might have pressed it too. But should we?

You see, an essential part of being not just a good teacher but a great one is understanding where your students stumble, what mistakes they make, and what challenges they face. Teachers often gain this knowledge through the process of assessment. So, we need to be cautious when it comes to automating these processes.

So, what’s the solution here?

Firstly, we must recognize that learning always involves overcoming challenges. Without resistance, there is no learning.

The human mind is programmed to look for shortcuts, always to find the most efficient solution. It’s evolutionary, we want to conserve energy.

But if we always take the shortcut, we’re depriving ourselves of learning skills that will benefit us long-term.

Think of it like climbing a hill. Technology can offer to carry us to the top, but I believe that would be a mistake.

There is another way! The remarkable thing about AI is that we can ask it to act as a coach and guide, helping us conquer that hill through our own effort rather than taking shortcuts or doing all the work for us.

In the field of education, we’re seeing some exciting solutions that follow this approach. Take Khan Academy, for example. They’ve integrated GPT4 in a way that doesn’t just provide answers but helps students understand how to solve problems, like math, for themselves. You can also use tools like ChatGPT or Bing, or Google Bard in similar ways.

For those of you in the audience, it might be as simple as shifting from asking ChatGPT to write a text for you to writing it yourself and then seeking ChatGPT’s feedback. Such a small change can make all the difference.

We need to continually ask ourselves every time we hand over a task to AI: are we robbing ourselves of a valuable learning experience?

What I’m getting at is whether AI plays the role of the dragon or the knight in our story is a choice that you can make.

It’s your call. And you can only make that choice if you’re aware of it.

And now – you are.

Årets buzzword har onekligen varit AI. Artificiell intelligens. Överallt pratar och skriver folk om det, och då framförallt generativ AI och ChatGPT. I skolsammanhang har diskussionen ofta kommit att handla om fusk, men också om möjligheter. Här skulle jag vilja komplettera samtalet med tanken om att det svenska skolsystemet i sig är konstruerat på ett sådant sätt som gör att det blir särskilt sårbart för teknologer såsom AI. Problemet ligger i den svenska skolans målstyrning.

En konsekvens av målstyrningen i skolan är att vi tenderar att mäta lärande utifrån måluppfyllelse. Problemet med målrelaterad pedagogik är att den riskerar att leda till en praktik där eleverna primärt skapar produkter som skall bedömas. Det kan handla om att skriva ett vetenskapligt PM, att författa en rapport eller ett gymnasiearbete. Men lärandet sker i processen, vägen till den färdiga produkten. Målrelaterade utbildningssystem blir därför särskilt utsatta för teknologer såsom generativ AI som automatiserar processer. Risken är att det skapar incitament för byggandet av kunskapsslott av luft. Det ser bra ut, men inuti är det bara tomt.

För att hantera dessa utmaningar och ta tillvara på potentialen av AI i skolan, behöver vi därför tänka om. Vi behöver minska fokusering på måluppfyllelse och börja mäta faktiskt utbildningseffekt. Detta kräver bland annat en tydlig progression i ämnen med definierat innehåll och mål. Exempelvis behöver ett ämne som svenska omvärderas där skrivandet som en aktivitet i sig uppvärderas. För att travestera Karin Boye: ”Nog finns det mål och mening i vår färd – men det är vägen, som är mödan värd”. Meningen ligger inte i den färdiga produkten, och därför behöver vi skapa incitament för att värdesätta processen mer.

Det svenska utbildningssystemet står inför ett vägskäl. För att inte gå vilse behöver vi reformera det. För att få fart frammåt behöver vi paradoxalt nog kanske göra mer som vi gjorde förr. Gör vi inte det riskerar vi att hamna i en situation med ökad ojämlikhet och allt fler elever som lämnar skolan utan tillräcklig kunskap. Men om vi gör det kan vi skapa ett sammanhang där vi tar tillvara på de möjligheter som AI faktiskt erbjuder. Vi behöver säkerställa ett skolsystem där teknologin tjänar som ett verktyg för verkligt lärande, snarare än ett sätt att enbart uppnå yttre mål.

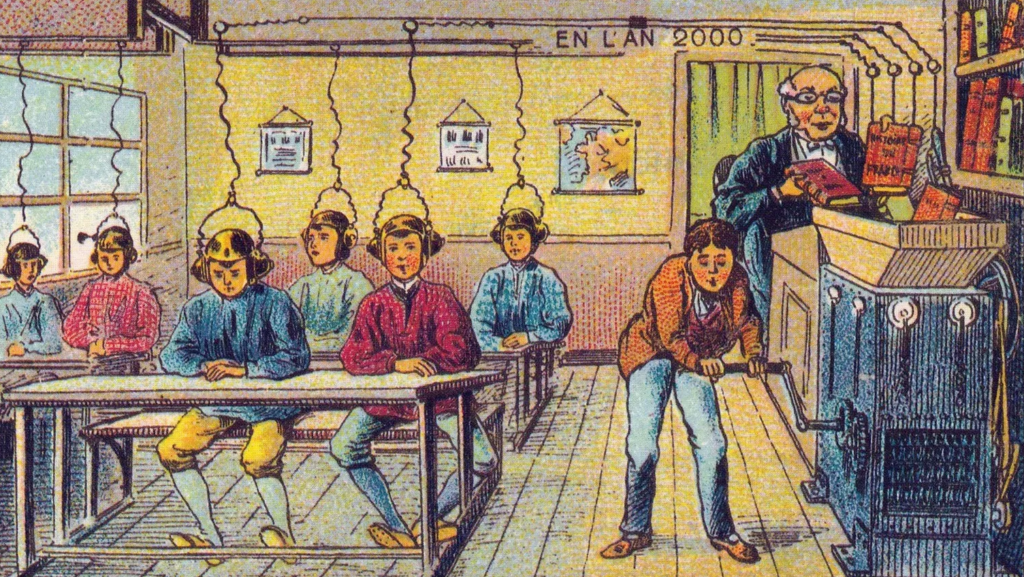

* Bilden ovan är en del av en serie illustrationer skapade av franska konstnärer mellan 1899 och 1901. Dessa konstnärer föreställde sig hur Frankrike skulle kunna se ut ett sekel framåt i tiden. Illustrationen skildrar en fransk skolklass såsom man tänkte sig den år 2000. Fler av dessa bilder kan du hitta här.

I dagarna släppte The Beatles en ny singel, Now and then. 53 år efter att bandet upplöstes.

John Lennon skrev låten 1970, när Beatles fortarande fanns. Sju år senare sjöng han in en demo. Med hjälp av AI har kvalitén på denna demo förbättrats. Resten är ett ihopplock. George Harrisons gitarr kommer från en inspelning gjord 1995. I nutid har Ringo Starr och Paul McCartney adderat trummor, gitarr och piano. Det låter fantastiskt. Alex Schulman skrev i en krönika i DN att han lyssnade på låten medan han körde bil och blev så tagen att han fick stanna och gråta. Överdrivet? Nej, för jag erfor faktiskt precis samma sak. Det är märkligt det där, vad musik kan göra med en.

Vi har alla våra favoritartister och ofta anser vi att ett visst album, eller en viss period var artistens peak. Ofta är det något som vi vill ha mer utav, och med AIs hjälp kommer vi att få detta (eller åtmindstone illusionen av det). Denna utveckling kommer att leda till att för den som exempelvis tyckte att Depeche Mode spårade ur efter Violator, men som ändå vill ha fler Depeche Mode-album, kommer att kunna få låtar genererade som är unika men som låter som Depeche Mode lät runt 1990.

Det är inte science fiction. Tekniken är redan här. Beatles Now and Then är bara ett i raden av exempel. Det kommer att komma mer. Teknikutvecklingen gör det allt enklare och mer tillgängligt, och efterfrågan kommer inte att saknas. Men det väcker också frågor. Hur tänker vi med upphovsrätten? Kan man kräva upphovsrätt på ett uttryck och sound?

Men kanske är de främsta frågorna hur vi skall förhålla oss till det hela och vad detta gör med oss. Om jag reflekterar över mitt eget musiklyssnande erfar jag tydligt hur detta har förändrats med streaming. När jag som fattig student åkte till Skivhugget eller Bengans för att köpa en skiva så var det en investering. Det gav ett incitament till att verkligen lyssna på den där skivan, och på de där spåren som jag numera allt för enkelt kan hoppa över. Men så här i efterhand är många av spåren med lite initialt motstånd de som jag kommit att uppskatta mest. Så vad händer när vi allt mer matas av minsta möjliga motstånd? Samtidigt som The Beatles Now and Then verkligen berörde mig.

Vad tänker du?

Tips! För alla musikintresserade rekomenderar jag Rick Beato s YouTube-kanal där han för ett tag sedan just adresserade AI-genererad musik.

Den 20e november deltar jag på Internetstiftelsens konferens Internetdagarna. Under rubriken ”Kan AI vara en bra pluggkompis?” föreläser först Torkel Klingberg, varpå jag och Micke Kring tillsammans med Torkel skall samtala om AI och lärande. Moderator är Johanna Koljonen.

Det skall bli roligt!

Igår hade jag förmånen att få hålla ett ”TED-talk”. Mitt tal Cheating or Coaching? Walking the AI tightrope in education handlade om AI och lärande.

Ett stort tack skall riktas till TEDx Göteborg och alla människor som genom organisationen utför ett fantastiskt arbete! Arrangemanget ägde rum i Chalmers konferenscenter. Övriga talare var Gourgen Gevoryan, Staffan Truvé, Liz Rider och Reneé Göthberg. Nu väntar vi på att talen skall klippas ihop, publiceras och sedan spridas.

Under våren har jag träffat och lyssnat till hur lärare erfar att deras arbete har påverkats av generativ AI, såsom ChatGPT. Inför sommaren satte jag mig ner och summerade mina erfarenheter och tankar i en film. Filmen vänder sig främst till dig som arbetar som lärare, men också till övrig skolpersonal och skolledning. Det är uppenbart att vi just nu står i början av något som kommer att påverka oss alla. Teknikutvecklingen i sig tror jag inte att vi kan bromsa, men tillsammans kan vi förhoppningsvis styra vårt användande av tekniken åt ett positivt håll. Men det kräver gemensam klokskap, samarbete och samtal.

Filmen får ni gärna använda er av. Önskar ni kompletterande diskussionsfrågor, eller om ni har frågor på själva innehållet, kanske vill ni lägga till något, eller om det är något som ni tycker är fel – hör bara av er.

Dela gärna filmen vidare!

De länkar som jag nämner i filmen är:

Multi-Agent Hide and Seek

Googles AI-kurs

Khan Academy GPT4 demo